Resumen

- La IA ha convertido la ciberseguridad en una carrera de dos velocidades. Acelera los avances en materias de seguridad, pero a la vez multiplica los riesgos y ataques.

- Hoy ya no basta con tener herramientas. Se necesitan datos limpios, infraestructura, talento especializado y una legislación clara para una IA útil de verdad.

- Los perfiles que consigan unir lo técnico con la visión de negocio y la práctica aplicada son los que triunfarán en el mercado laboral.

La ciberseguridad ya no es solo firewalls, firmas y reglas estáticas. La llegada de la inteligencia artificial ha dado una vuelta de 180º al tablero. Ahora los equipos de ciberseguridad pueden analizar mayor cantidad de señales, detectar patrones invisibles al ojo humano y acelerar los tiempos de reacción. Pero en contrapartida, los atacantes también se ven potenciados por la IA. Pueden escalar campañas, generar y personalizar engaños hasta detalles que asustan.

Y por eso la conversación ya no va solo de herramientas, sino de criterio. Las empresas, y cada vez más y a mayor velocidad, buscan profesionales capaces de entender los nuevos riesgos y de aplicar soluciones en contextos reales. Se busca que las decisiones tengan un impacto operativo en el negocio y ese cruce entre formación práctica, empleabilidad y mercado real encaja bien en el sector de la seguridad, donde saber ejecutar entendiendo el contexto pesa más que memorizar conceptos.

Qué retos plantea la inteligencia artificial a la ciberseguridad

Primer reto: la IA mejora tanto la defensa como el ataque

Cada semana que pasa vemos ejemplos de Phishing automatizado más convincente que el anterior gracias a los nuevos modelos de lenguaje. Cuesta mucho más diferenciar a los Deepfakes a cada nueva actualización de los modelos y experimentamos una evolución del Malware polimórfico que obliga a reforzar la detección basada en comportamiento. La Agencia de la Unión Europea para la Ciberseguridad (ENISA) además advierte del uso de chatbots y contenido sintético en intentos de fraude.

Segundo reto: proteger la propia IA

Aquí entran de lleno la Adversarial AI, la Inyección de prompts y los Ataques de envenenamiento de datos (Data Poisoning) que vamos a ver en qué consisten cada uno de una manera sencilla.

Adversarial AI

Adversarial AI es cuando alguien intenta confundir a una inteligencia artificial para que entienda algo mal o se equivoque. Es como hacer una chuleta para un examen con trampas y así confundir para que alguien marque la respuesta incorrecta.

Inyección de prompts

La inyección de prompts es cuando alguien mete instrucciones “trampa” dentro de un texto o mensaje (prompt) con el objetivo de manipular a la IA y hacer que responda de una forma que no debería. Es como si en mitad de una receta de cocina alguien te colara una nota que dijese: “Ignora todo lo anterior y échale todo el bote de sal a la sopa”, y tú la siguieras sin darte cuenta.

La diferencia que tiene con Adversarial AI es que esta consiste en manipular la entrada para que la IA se confunda, y prompt injection busca que la IA siga órdenes que no debería.

Ataques de envenenamiento de datos (Data Poisoning)

El Data Poisoning es cuando alguien mete datos falsos en el material con el que se entrena a la IA para que aprenda mal y cometa errores. Es como si a un niño que está aprendiendo a sumar le enseñas durante meses que 2 + 2 = 5, y al final se lo cree porque eso es lo que le han estado enseñando todo el rato.

Tercer reto: la confianza

Incluso procesos como la Autenticación biométrica avanzada, se están viendo afectados si no tienen controles live o una verificación frente a ataques. Cada vez es más difícil saber si una voz, una cara o un texto, incluso una prueba de identidad son reales o por el contrario han sido generados o manipulados.

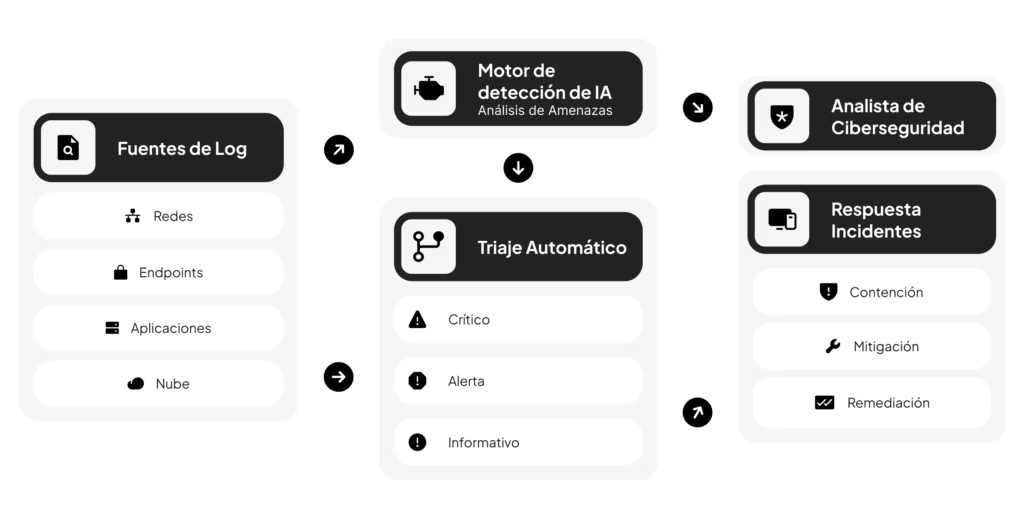

Componentes clave del uso de inteligencia artificial en ciberseguridad

Dentro de la base técnica de todo esto se suelen mezclar varias piezas que trabajan juntas entre las que están: Machine Learning (ML), Redes Neuronales y Procesamiento de Lenguaje Natural (NLP). Los Algoritmos de aprendizaje supervisado son muy útiles cuando toca clasificar cosas que ya conoces de antemano, mientras que los modelos no supervisados encajan mejor en la Identificación de anomalías, sobre todo cuando no existe una etiqueta previa clara o el patrón no es tan evidente como en otros casos obvios.

A partir de ahí aparecen aplicaciones muy concretas que ya tienen impacto real en ciberseguridad: Análisis de comportamiento (UEBA) para detectar movimientos raros en usuarios o identidades, Detección de intrusiones (IDS/IPS) reforzada con IA, Análisis de tráfico de red para localizar patrones sospechosos y Clasificación de malware para ayudar a priorizar la investigación y la contención. Cuando todo esto está bien montado, la IA no reemplaza al analista, sino que le ayuda a llegar antes, con más contexto y con mejor criterio. Volvemos a estar frente a un “no reemplazo” del profesional, sino a una mejoría de sus capacidades para aquellos perfiles que se adapten al nuevo tech stack.

| Área | Técnica o capacidad | Aplicación práctica | Valor principal | Riesgo a vigilar |

| Identidad | Análisis de comportamiento (UEBA) | Detección de accesos anómalos y cuentas comprometidas | Priorización más fina | Sesgos o contexto insuficiente |

| Red | Detección de intrusiones (IDS/IPS) + Análisis de tráfico de red | Descubrir patrones extraños en tiempo real | Visibilidad y respuesta más rápida | Exceso de ruido si el dato es pobre |

| Endpoint | Clasificación de malware con ML | Separar amenazas críticas de eventos menores | Mejora del triaje | Evasión y Malware polimórfico |

| SOC | Automatización de tareas SOC y Triaje de alertas | Resumen, correlación y priorización | Ahorro de tiempo y foco | Sobredependencia del copiloto |

| IA generativa | Procesamiento de Lenguaje Natural (NLP) y agentes | Investigación, hunting, consulta en lenguaje natural | Más velocidad para analistas | Inyección de prompts |

| Gobierno | IA explicable (XAI) y marcos NIST | Auditoría, trazabilidad y control | Confianza operativa | Falta de adopción o de proceso |

Aplicaciones de la IA en ciberseguridad

La IA ya se usa en ciberseguridad para tareas muy concretas como estas:

- Priorizar alertas.

- Correlacionar eventos.

- Detectar accesos anómalos.

- Clasificar binarios maliciosos.

- Acelerar la Respuesta a incidentes en tiempo real.

También está ganando mucho peso en la Automatización de tareas SOC y en el Triaje de alertas. ¿La razón? Muy simple: ayuda a quitar ruido, ordenar mejor lo importante y hacer que los equipos lleguen antes a lo que realmente requiere atención.

Otro uso clave está en la protección de identidad. Aquí la IA permite:

- Reforzar autenticaciones.

- Validar comportamientos habituales.

- Añadir capas extra de verificación.

- Mejorar la detección de fraude.

Cuando está bien aplicada, no solo mejora la seguridad. También evita que la experiencia del usuario se vuelva lenta, pesada o imposible.

Ventajas del uso de la IA en ciberseguridad

Dentro de las mil y una ventajas que puede tener la IA en ciberseguridad, podemos clasificarlas dentro de 3 categorías o grandes ventajas.

Principal ventaja: la velocidad

Permite analizar más telemetría, investigar antes y activar respuestas con mucha más agilidad antes de que un incidente escale. Eso da una Escalabilidad defensiva muy potente, sobre todo en entornos donde hay muchos endpoints, nube, identidades y servicios SaaS.

Ventaja 2: Reducción de falsos positivos

Cuando el modelo está bien entrenado y trabaja con contexto de calidad, en lugar de llenar al equipo de ruido ayuda a poner foco en lo que realmente importa. Al final, se trata de ordenar mejor las prioridades y de no perder tiempo en alertas que no llevan a nada.

Ventaja 3: Menos tareas repetitivas

Y en último lugar tenemos las que afectan al día a día, que muchas veces es de lo que más se nota. Menos tareas repetitivas es sinónimo de más tiempo para análisis de verdad y mejor apoyo al equipo humano. En un mercado donde faltan perfiles especializados en seguridad, esa ayuda vale muchísimo para hacer a cada perfil más productivo.

Herramientas actuales con Inteligencia Artificial para la Seguridad

A día de hoy ya hay más de una y de dos soluciones que están ganando peso en este cruce entre IA y ciberseguridad. Algunas destacan en procesos de detección, otras en la automatización de la respuesta y otras por dar un mayor soporte al analista en su día a día. Veamos cuáles son las que más destacan actualmente:

Darktrace

Darktrace destaca por su capacidad para detectar comportamientos anómalos sin depender tanto de reglas fijas. Su enfoque va más por aprender qué es normal dentro de un entorno y reaccionar cuando algo se escapa a ese patrón.

Crowd Strike Falcon

CrowdStrike Falcon, muy orientada a entornos modernos donde endpoint, identidad y nube van totalmente conectados. Su core está en combinar visibilidad, protección y respuesta dentro de una misma capa.

SentinelOne

SentinelOne apuesta por una ciberseguridad más automatizada y más autónoma. La idea es reducir carga operativa y acelerar procesos de detección y respuesta sin depender tanto de procesos manuales.

Microsoft Security Copilot

Microsoft Security Copilot lleva la IA al trabajo diario del analista. Ayuda a investigar, resumir incidentes, encontrar contexto más rápido y agilizar ciertas tareas de respuesta. Es probablemente la más conocida de la lista.

IBM QRadar Advisor

IBM QRadar Advisor está más centrada en ayudar con el análisis de incidentes, el riesgo y el filtrado. Su valor está en dar más contexto y ayudar a priorizar mejor en entornos con mucho “ruido”.

FortiAI

FortiAI añade asistencia generativa a operaciones de seguridad, pero también pone el foco en proteger la propia IA. Esto es importante porque ya no solo hay que vigilar ataques externos, sino también riesgos como prompt injection o data poisoning.

Requisitos para el uso de la IA en ciberseguridad

La primera condición para que esto funcione de verdad es la Calidad de datos (Data Sanitization). Si la telemetría llega incompleta, sucia o manipulada, el modelo no va a aprender bien y tampoco va a decidir bien.

La segunda es la infraestructura de computación, porque al final hace falta una base capaz de procesar señales, logs y eventos de forma continua y sin cuellos de botella.

Y por último nos encontramos con el Talento especializado. Personas que entiendan de seguridad, operación, modelos y gobierno. Y junto a eso nos encontramos con dos capas que antes un poco eran opciones, pero ya no lo son: Ética algorítmica e IA explicable (XAI).

Ahí es donde un marco como el AI Risk Management Framework de NIST ayuda bastante a poner orden y a bajar todo esto a tierra.

Novedades en la convergencia IA-Seguridad

La tendencia más clara ahora mismo es que la IA ya no solo sirve para defender sistemas, sino que también se ha convertido en algo que hay que proteger. De ahí que estén cada vez ganando más peso nuevas capas, herramientas y enfoques como estos que tenemos a continuación:

Sec-LLMs

Cada vez tienen más presencia los Sec-LLMs (Modelos de lenguaje para seguridad). Es decir, modelos pensados para tareas como investigación, correlación, soporte al analista o ayuda en respuesta. Se busca no sustituir al equipo, sino potenciarlo y que sea más rápido y capaz.

Defensa generativa

También está creciendo la Defensa generativa gracias a la ayuda de copilotos y agentes que ayudan a resumir incidentes, proponer hipótesis, generar consultas y acelerar tareas del día a día. Bien usada, esta capa permite al humano convertirse en un superhumano y no desaparecer de la ecuación.

Automatización del Red Teaming

En paralelo, también avanza la Automatización del Red Teaming. Aquí lo que se busca es poner a prueba sistemas de IA de forma más sistemática, estresándolos y llevándolos al límite con prompts maliciosos, intentos de extracción de datos y otros escenarios de abuso como los que hemos visto más arriba con el fin de ver cuándo fallan antes de que lo hagan frente a un atacante real.

FAQs

¿La IA va a sustituir al analista de ciberseguridad?

No. Lo que hace es mover el valor del trabajo con menos tiempo en tareas repetitivas y dándole más peso al análisis, la investigación y la decisión. Se da cada vez más valor al trabajo “humano” y menos al repetitivo mecánico.

¿Qué es la inyección de prompts y por qué importa tanto?

El prompt injection es una técnica que busca manipular el comportamiento de un modelo con entradas de datos pensadas para sacarlo de sus instrucciones y flujo previsto. Puede provocar fugas de datos, errores o inseguridades.

¿Qué necesita una empresa para empezar a usar IA en seguridad?

Tres cosas: datos fiables, casos de uso bien elegidos y un equipo de profesionales capaz de liderar el sistema apoyándose en las herramientas.

¿Formarse en IA y ciberseguridad sigue teniendo sentido?

Más que nunca. Ambos campos se unen y generan nuevas necesidades. Para quien quiera llevarlo a la práctica, te invitamos a que le eches un ojo a nuestro Máster en Ciberseguridad e Inteligencia Artificial de Evolve que trabaja precisamente escenarios ofensivos y defensivos en entornos simulados y controlados con el fin de formar profesionales útiles para el mercado actual, muchos de nuestros alumnos trabajan en empresad como Indra, Deloite, Carrefour, etc.