Sam Altman, CEO de OpenAI, lleva tiempo defendiendo que está más cerca de lo que muchos piensan. Andrej Karpathy, en cambio, suele poner más matices, marcar límites y recordar que los modelos actuales siguen siendo otra cosa. Mientras tanto, en LinkedIn y en muchos medios tecnológicos, el término se usa casi a diario sin demasiado rigor.

El problema no es que el debate no sea interesante, al contrario: probablemente será uno de los debates más importantes de los próximos años, pero para hablar de AGI con criterio, primero hay que entender bien de qué estamos hablando: qué es realmente, en qué punto estamos hoy y qué implicaciones tendría, tanto si llega pronto como si tarda más de lo que algunos predicen.

Qué es la Inteligencia Artificial General (AGI o IAG), definición y características

La inteligencia artificial general (AGI, del inglés Artificial General Intelligence, o IAG en español) se refiere a un sistema capaz de aprender, razonar y resolver cualquier tarea cognitiva que pueda realizar un ser humano, sin estar diseñado específicamente para ninguna de ellas.

Lo que la define no es la potencia de cálculo ni el tamaño del modelo, es la generalización: la capacidad de transferir conocimiento de un dominio a otro, aprender de una manera autónoma en contextos nuevos y razonar en abstracto frente a problemas que nunca ha visto antes. Eso es lo que la distingue de cualquier herramienta que usamos hoy.

El test de Turing, propuesto por Alan Turing en 1950, es uno de los referentes históricos para pensar en la inteligencia artificial como algo indistinguible del comportamiento humano. Aunque el debate sobre si sigue siendo un criterio válido está muy vivo, ayuda a entender la ambición original detrás del concepto.

Si quieres entender mejor los fundamentos de la IA antes de profundizar en la AGI, te recomendamos leer nuestro artículo Qué es la inteligencia artificial.

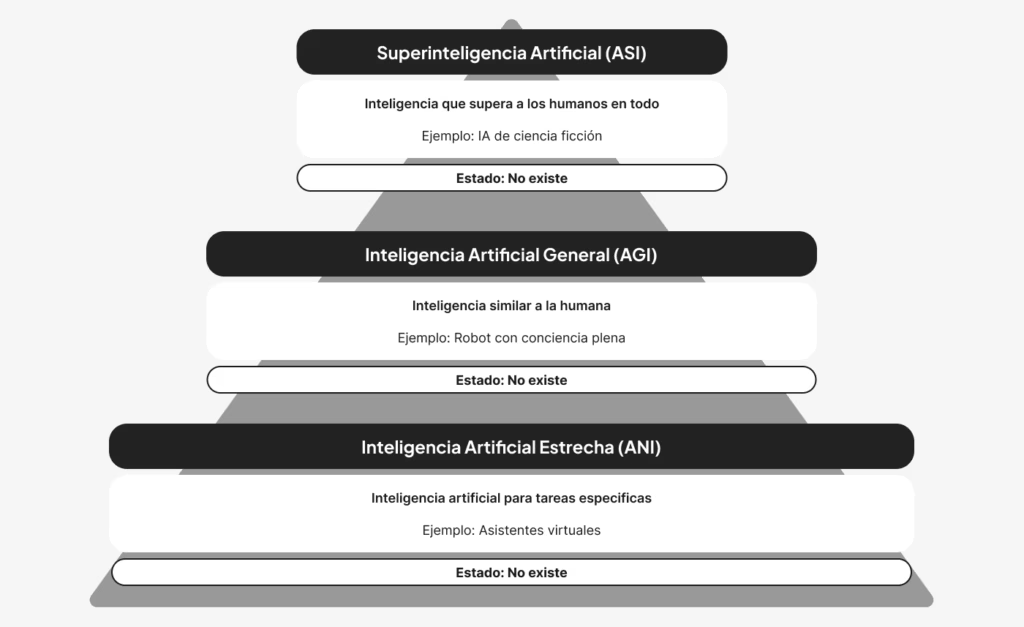

IA estrecha vs. IA general vs. Superinteligencia: las 3 categorías de la IA

La confusión entre distintos tipos de IA es uno de los motivos por los que el debate público se complica. Hay tres categorías que conviene distinguir con claridad:

La IA estrecha (ANI)

Lo que tenemos hoy en día: sistemas muy capaces dentro de su dominio, pero incapaces de salir de él. Un motor de recomendación, un detector de fraude o un modelo de lenguaje como los actuales entran en esta categoría.

La superinteligencia (ASI)

Es el nivel siguiente a la AGI: un sistema que superaría al ser humano en todas las dimensiones cognitivas. Hoy es un debate filosófico y de seguridad más que una realidad técnica próxima.

| Tipo | Nombre | Capacidad | Estado actual |

| ANI | IA estrecha | Una tarea o dominio concreto | Existe y se usa a diario |

| AGI | IA general | Cualquier tarea cognitiva al nivel humano | No existe aún |

| ASI | Superinteligencia | Supera al ser humano en todo | Concepto teórico |

Estado actual de la AGI en 2026: ¿qué tan cerca estamos realmente?

Los modelos fundacionales actuales, desde GPT-5 hasta Claude o Gemini, son herramientas muy potentes. Son capaces de superar benchmarks que hace apenas unos años parecían fuera del alcance de una máquina, muestran comportamientos emergentes llamativos y ya han cambiado la forma de trabajar en muchos sectores. Pero siguen siendo ANI sofisticada, no AGI.

No generalizan de verdad como lo haría una inteligencia humana, no aprenden de manera continua y autónoma por sí solos, y tampoco razonan en abstracto ante un problema completamente nuevo como lo haría una persona.

Avances como el few-shot learning o el desarrollo de agentes autónomos son pasos importantes en esa dirección, pero no equivalen a inteligencia artificial general. El escalado de modelos ha generado capacidades impresionantes, pero cada vez más investigadores señalan que hacer modelos más grandes no bastará, por sí solo, para cruzar ese umbral.

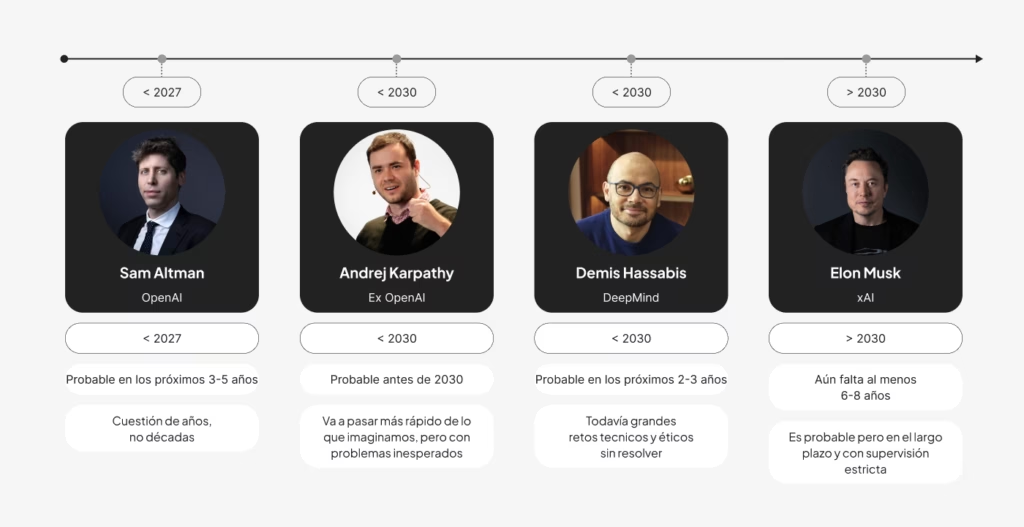

El debate entre expertos: Altman, Karpathy, DeepMind y las predicciones

Sam Altman (OpenAI)

Ha sostenido en varias ocasiones que la AGI podría llegar antes de lo esperado, posiblemente dentro de esta década. Su posición es que los avances actuales en escalado y en arquitecturas de modelos fundacionales nos acercan de forma acelerada a ese punto.

Andrej Karpathy

Ofrece una visión más matizada. Insiste en que los LLMs actuales son herramientas estadísticas muy potentes, pero no sistemas que razonan ni que aprenden de forma genuina. Para él, hablar de AGI con los modelos actuales como punto de referencia es saltar demasiados pasos.

Demis Hassabis (DeepMind)

Apuesta por un camino más sistemático, combinando modelos de lenguaje con razonamiento simbólico y aprendizaje por refuerzo, al estilo de lo que hicieron con AlphaFold. Cree que la AGI es alcanzable pero que requiere saltos cualitativos, no solo más potencia de cálculo.

Elon Musk y su proyecto xAI con Grok

También han entrado en el debate con predicciones ambiciosas, aunque con agendas distintas. Y desde España, iniciativas como ALIA también apuntan a desarrollar capacidad propia en modelos fundacionales.

Lo que une a casi todos es la incertidumbre real. Las predicciones varían de «ya casi» a «décadas por delante». Eso, de por sí, ya dice mucho sobre dónde estamos.

Tecnologías que impulsan el camino hacia la AGI

El camino hacia la AGI no depende de una sola tecnología, es una convergencia. Los modelos fundacionales y la multimodalidad permiten que los sistemas procesen texto, imagen, audio y código de forma integrada. El aprendizaje por refuerzo permite que los modelos aprendan a partir de interacciones, no solo de datos estáticos. Y la transferencia de conocimiento entre dominios es uno de los retos técnicos más importantes para acercarse a una generalización real.

Agentes autónomos: ¿el siguiente paso?

Uno de los desarrollos más activos ahora mismo son los agentes autónomos: sistemas que no solo responden, sino que planifican, ejecutan tareas y se adaptan a entornos cambiantes. No son AGI, pero representan un salto cualitativo respecto al modelo de chatbot puro. Su evolución es una de las pistas más claras sobre hacia dónde va la investigación.

Qué implicaciones tiene la AGI para las empresas y el mercado laboral

Si algún día llega la AGI, el cambio para empresas y profesionales sería bastante más serio que lo que estamos viendo ahora con la IA generativa. No estaríamos hablando solo de automatizar tareas repetitivas o ahorrar tiempo en procesos concretos. Estaríamos hablando de sistemas capaces de razonar mejor, plantear estrategias, conectar información de áreas distintas y tomar decisiones complejas con mucha más autonomía.

En el mercado laboral, el golpe más importante quizá no sería una destrucción masiva de empleos de un día para otro, sino algo más profundo: cambiaría qué perfiles se consideran realmente valiosos. Ahí ganarían peso las capacidades que no se pueden copiar tan fácil: tener criterio, entender el contexto, hacer buenas preguntas, interpretar resultados con visión de negocio y saber trabajar con personas de otros equipos.

Por eso, las empresas que mejor lleguen a ese escenario no serán las que esperen a que todo explote para reaccionar. Serán las que ya estén construyendo desde ahora una base sólida: más capacidad analítica, talento bien formado y una cultura de dato que no se quede solo en el discurso. Ese tipo de preparación no se improvisa. Lleva tiempo, y empieza bastante antes de que la AGI sea una realidad.

Retos éticos y de seguridad de la Inteligencia Artificial General

La alineación de la IA (AI alignment) es probablemente el reto más crítico de cara a la AGI: asegurarse de que un sistema con capacidad cognitiva general actúe de acuerdo con los valores e intereses humanos. No es un problema resuelto y muchos investigadores lo ven como uno de los retos más importantes del campo ya que una IA más capaz no es automáticamente una IA más segura, más justa o más fácil de controlar.

A partir de ahí entran temas mucho más delicados: riesgo existencial, gobernanza global, opacidad algorítmica y control democrático. Por eso la ética algorítmica ya no puede tratarse como una charla bonita para cerrar una conferencia. Si hablamos en serio de AGI, se convierte en una necesidad práctica y urgente.

En Europa, el EU AI Act y la creación de la AESIA (Agencia Española de Supervisión de Inteligencia Artificial) son señales de que la regulación de IA ya no es opcional. La OCDE también ha establecido principios clave para una IA fiable, con énfasis en transparencia, trazabilidad y respeto a los derechos fundamentales.

Cómo prepararte profesionalmente para un futuro con AGI

No hace falta esperar a la AGI para que la IA empiece a cambiar tu trabajo porque eso ya está pasando, con la IA estrecha que usamos cada día, y que cada vez sigue más en auge.

Lo que sí cambia con el debate sobre la AGI es el horizonte que conviene tener en la cabeza. Los perfiles más resistentes no serán los que sepan usar una herramienta concreta, porque esa herramienta puede quedarse vieja rápido, sino los que entiendan bien cómo funciona la IA, sepan llevar ese conocimiento a contextos distintos y puedan decidir con criterio cuando el entorno no está del todo claro.

En Evolve trabajamos exactamente eso: formación práctica, orientada al mercado real y conectada con empresas que buscan perfiles capaces de trabajar con IA de verdad. Si quieres entender de dónde venimos y hacia dónde vamos, el Máster en Data Science & Desarrollo de IA es un buen punto de partida.

FAQs

¿Los modelos actuales como GPT-5, Claude o Gemini son AGI?

No. Son ejemplos muy avanzados de IA estrecha (ANI). Pueden realizar tareas impresionantes dentro de sus dominios de entrenamiento, pero no generalizan de forma autónoma ni aprenden continuamente en entornos nuevos como lo haría un sistema AGI.

¿Cuándo llegará la AGI según los expertos?

Las predicciones varían enormemente. Sam Altman habla de años, mientras que investigadores como Andrej Karpathy son más escépticos sobre los plazos cortos. Demis Hassabis cree que es alcanzable pero que requiere saltos cualitativos, no solo más escalado. No hay consenso.

¿La AGI supone un riesgo para el empleo?

Una AGI real tendría implicaciones laborales muy profundas, mucho más que la IA actual. Pero antes de llegar ahí, la IA estrecha ya está transformando roles y tareas. El reto inmediato no es prepararse para la AGI, sino entender bien la IA que ya existe y desarrollar las competencias que más cuestan de automatizar: criterio, comunicación y pensamiento crítico.

¿Qué es la alineación de IA y por qué importa tanto?

La alineación (AI alignment) es el problema de asegurarse de que un sistema de IA actúe de acuerdo con los valores e intereses humanos, especialmente cuando ese sistema se vuelve muy capaz. En el contexto de la AGI, es el reto de seguridad más crítico y uno de los campos de investigación más activos en organizaciones como Anthropic, DeepMind u OpenAI.