Resumen

- La ciencia de datos convierte los datos dispersos en decisiones útiles, modelos predictivos y todo ello en una ventaja competitiva.

- No es solamente programar. Hablamos de combinar estadística, negocio, limpieza del dato y su posterior visualización.

- El Data Science es útil cuando conecta tecnología y negocio, KPIs y eso deriva en decisiones mejor informadas y de más valor.

Cuando hablamos de Data Science ya no estamos hablando de algo futurístico. Estamos hablando de la actualidad, de cómo trabajan hoy las empresas que quieren entender mejor sus negocios. Cada clic, cada compra, cada ticket de soporte y cada proceso realizado deja rastro. La diferencia está en saber leer y aprovechar ese rastro.

Ahí es donde entra en juego la ciencia de datos. Una disciplina que mezcla tecnología, análisis y visión de negocio para convertir información en acciones. Los datos son el recurso esencial que no basta con acumular, sino que hay que buscar y encontrar patrones para reducir la incertidumbre y tomar mejores decisiones en contextos reales.

Definición de Data Science (Ciencia de datos)

La ciencia de datos es la disciplina que se encarga de generar valor a partir de datos mediante técnicas de estadística, programación, análisis y modelado. Tiene como objetivo no solamente describir lo que ha pasado, sino entender por qué ha pasado y anticipar qué puede ocurrir después.

En la práctica, el data science reúne tareas como:

- Recolección de datos.

- Minería de datos.

- Organización de la estructura de datos.

- Análisis y construcción de modelos.

La Comisión Europea la sitúa precisamente en el punto que une estadística, análisis de datos, machine learning e inteligencia artificial.

Para qué sirve y su importancia

El Data Science sirve para transformar información en decisiones de valor. Desde detectar fraude hasta tener una previsión “real” de la demanda, mejorar campañas u optimizar operaciones. Ayuda a pasar de la intuición a la toma de decisiones basada en datos.

Es de vital importancia ya que conecta negocio y evidencia con el dato. Cuando una empresa mide bien sus KPIs, entiende mejor a sus clientes y le permite centrarse allí donde hay más valor y conseguir una ventaja competitiva. Por eso el dato ya no es solo un activo que se guarda. El dato se convierte en una palanca de negocio y la ciencia de datos es la pieza clave para la innovación y la competitividad, como destaca la estrategia europea de datos.

Técnicas de la Ciencia de Datos

Detrás de cualquier proyecto de Data Science suele haber un proceso bastante reconocible. Primero se recogen los datos, luego se limpian, después se analizan para encontrar patrones y, a partir de ahí, se modelan para sacar conclusiones útiles. Y todo eso solo tiene sentido si al final se puede entender y convertir en una decisión. Estas son las diferentes técnicas:

Recolección de datos

Todo empieza aquí. Empezamos reuniendo datos para luego analizarlos. Si esta base es pobre o está mal planteada, todo lo demás ya va cojo.

Limpieza o Data Wrangling

Es el paso donde toca poner orden. Se corrigen errores, se rellenan huecos y se deja el dato listo para trabajar con él sin seguir arrastrando ruido innecesario.

Análisis exploratorio

Llegamos a la fase donde se miran los datos con calma para entender qué nos están contando. Aquí florecen patrones, anomalías y relaciones que a simple vista no se ven.

Minería de datos

En este punto ya se busca extraer valor de forma más clara, encontrando segmentos, tendencias o conexiones útiles para una decisión posterior. Es donde el dato empieza a convertirse en algo accionable. Sería como empezar a ver el diamante tras haberlo extraído y pulido de la mina. Aún no se vende, pero ya se intuye el valor que tiene.

Visualización

No basta con tener un buen análisis si nadie lo entiende. Visualizar bien el dato nos ayuda a que lo importante se vea rápido y se pueda explicar mejor.

Decisión

El objetivo no es analizar por analizar. Queremos tomar decisiones mejores. Si el dato no ayuda en la decisión, no ha sido útil y lo hemos “perdido” por el camino.

Tecnologías en Data Science

En Data Science no hay una sola herramienta mágica, sino un stack bastante estandarizado en el mercado actual. Lo normal es combinar lenguajes, librerías y entornos diferentes en base al tipo de análisis, el volumen de datos y lo que se quiera resolver. En el tech stack destacan los siguientes:

Python

Python es seguramente el lenguaje más usado porque vale para casi todo dentro de Data Science. Es un poco la navaja suiza en el stack. Sirve tanto para analizar como para automatizar, modelar o trabajar con datos.

R

R sigue teniendo a día de hoy mucho peso a la hora de realizar tareas de análisis estadístico y en entornos más académicos o técnicos. Es muy útil cuando se busca profundizar en la parte matemática.

SQL

SQL es la base para consultar, cruzar y preparar datos antes de analizarlos. En la práctica, es de esas herramientas que casi siempre acaban apareciendo en el día a día y un básico de cualquier stack.

Pandas

Pandas se usa para manipular datos de forma rápida y bastante cómoda. Permite limpiar, ordenar, filtrar y transformar información sin complicarse mucho.

Jupyter Notebooks

Jupyter Notebooks encaja a la perfección cuando lo que se busca es analizar, probar cosas y documentarlo todo a la vez. Es muy útil para experimentar sin perder el hilo del proceso y así cruzar información y procesos entre compañeros que comparten tareas.

Business Intelligence

Las herramientas de BI permiten llevar el análisis a cuadros de mando, reporting y decisiones más visuales. No solo buscamos analizar, sino que tenga un impacto en el negocio.

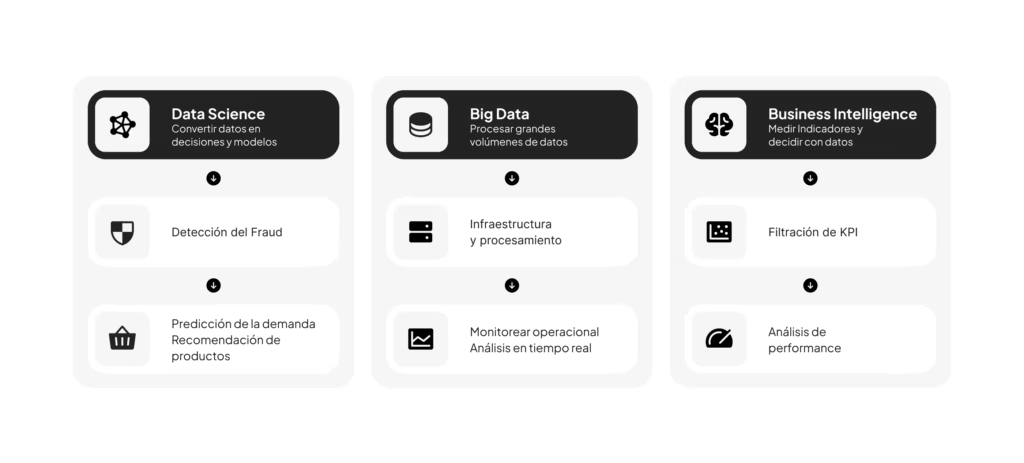

Diferencias entre Data Science y Big Data

Aunque suelen ir de la mano, no confundirlas porque no son lo mismo. Big Data es lo relativo al manejo de grandes cantidades de datos, sumado a retos de volumen, velocidad y variedad. Se centra en la infraestructura, el procesamiento y la escalabilidad.

Y en el otro lado, Data Science se enfoca en el análisis y la generación de valor. Puede trabajar junto al Big Data, pero también con datos mucho más pequeños.

Resumiendo la diferencia: Big Data se ocupa de mover y almacenar mucho dato. Es como tener un almacén gigante lleno de cajas con procesos y sistemas para ordenarlo sin que colapse todo. Y el Data Science se encarga de entenderlo y convertirlo en decisiones. Sería la persona encargada de abrir esas cajas, mirar lo que hay dentro y tomar decisiones sobre qué hacer.

| Concepto | Objetivo principal | Qué trabaja | Herramientas habituales | Resultado |

| Data Science | Extraer valor y predecir | Datos, patrones y modelos | Python, R, SQL, Pandas, Jupyter Notebooks | Insights y modelos predictivos |

| Big Data | Procesar grandes escalas | Volumen y velocidad de datos | Entornos distribuidos y pipelines | Infraestructura y procesamiento |

| Business Intelligence | Monitorizar y decidir | KPI, reporting y visualización | Dashboards y herramientas BI | Cuadros de mando y seguimiento |

Problemáticas y retos del Data Science

El reto más grande al que nos enfrentamos no está a nivel técnico. Está a nivel de la calidad. Si el dato llega mal, tarde o le falta contexto, el análisis va a ser peor. Hace falta una buena estructura de datos que asegure la fiabilidad del modelo.

A eso se suman otros problemas como sesgos, privacidad, diferencias entre equipos y expectativas poco realistas. Por suerte o desgracia, no todo se resuelve con algoritmos. Muchas veces el verdadero trabajo está en alinear negocio, tecnología y dato para que el análisis tenga un impacto real y no se quede en una prueba bonita.

Ejemplos reales

La parte teórica está muy bien, pero vamos a ver cómo podría traducirse esto en casos reales del día a día de una empresa.

- Un e-commerce utilizando Data Science para recomendar productos y tener una previsión del % de abandono de carritos.

- Un banco detecta anomalías en sus cifras en tiempo real.

- Un hospital priorizando casos críticos con ayuda de modelos de riesgo.

- Un equipo de marketing que ajusta su inversión según rendimiento, conversión y comportamiento de los usuarios.

También se utiliza la ciencia de datos para prever roturas de stock, optimizar rutas, anticipar demanda o medir productividad con más precisión. Y ante todos estos casos diferentes, siempre hay un denominador común: datos bien trabajados, contexto de negocio y decisiones mejores y de más valor.

Oportunidades laborales

Actualmente la salida profesional es un abanico enorme. El Data Science no está enfocado en un solo sector, sino que está presente en producto, marketing, finanzas, RR. HH., operaciones o IT. De ahí que perfiles como Data Analyst, Data Scientist, Data Engineer, BI Analyst o Machine Learning Engineer tengan cada vez más peso y estén mejor valorados dentro de empresas de muchos sectores.

Ante esta situación, formarse con un enfoque aplicado, como el que trabajamos en el Máster en Data Science, permite al talento que forma parte de nuestro ecosistema desarrollar habilidades que el mercado pide a día de hoy.

Ya no basta con saber usar herramientas. Ya no basta con saber encontrar y tener almacenados miles y miles de filas de datos. Ahora mismo el mercado busca perfiles capaces de traducir esas montañas de datos en decisiones. Ese enfoque encaja con cómo en Evolve entendemos la formación tecnológica: menos teoría aislada y más aplicación real.

Breve Historia y Futuro

La Ciencia de Datos no nació ahora con la IA generativa ni mucho menos. Viene de bastante antes. Nació en el cruce entre estadística, informática y análisis de negocio. Lo que sí ha cambiado de verdad en los últimos años no es tanto el origen, sino la escala. Hoy hay más datos, más capacidad de computación y herramientas mucho más accesibles que antes.

De cara al futuro más cercano, todo apunta a una Ciencia de Datos cada vez más metida en el día a día de las empresas. Veremos más automatización analítica y más decisiones apoyadas por sistemas inteligentes. Pero eso también va a exigir algo más importante que nunca: interpretar bien, validar mejor y usar los datos con criterio. Ahí es donde va a estar de verdad la diferencia entre alguien que usa herramientas y alguien que aporta valor y no será reemplazado por un algoritmo.

FAQs

¿Data Science y análisis de datos son lo mismo?

No exactamente. El análisis de datos suele centrarse más en interpretar información histórica. Data Science va un paso más allá e incorpora modelado, automatización y capacidad predictiva.

¿Hace falta saber programar para trabajar en ciencia de datos?

Sí, por lo menos a un nivel básico. Python y SQL son casi imprescindibles, y R sigue siendo útil en ciertos entornos analíticos. Pero lo más importante, más que ser un experto de uno u otro lenguaje, es que la parte técnica vaya acompañada de criterio de negocio.

¿Qué pesa más en Data Science: la estadística o la tecnología?

Las dos. Sería como preguntar si pesa más un kilo de hierro o un kilo de paja. La tecnología permite ejecutar, pero la estadística ayuda a entender qué estás viendo y a no sacar conclusiones erróneas. Sin esa base, es fácil caer en la construcción de modelos que parecen buenos pero no lo son.

¿Qué tipo de empresas buscan estos perfiles?

Prácticamente cualquier empresa que quiera decidir mejor. Todo tipo de sectores: banca, salud, retail, industria, logística, consultoría, recursos humanos o producto digital.